GPT-Image-2 à l'épreuve du marketing : 7 scénarios notés + méthodologie de prompts (2026)

Test terrain de GPT-Image-2 en marketing : 7 scénarios notés, 75 % de sortie prête à l'usage, 99 % de précision sur le texte. Méthodologie de prompts et retours communauté inclus.

OpenAI a sorti GPT-Image-2 cette semaine, et en 12 heures il avait pris la première place dans toutes les catégories du Image Arena leaderboard — battant le concurrent suivant de +242 points Elo. Ce n'est pas une amélioration incrémentale. C'est une catégorie d'outil différente.

À en croire les benchmarks publics et les retours communautaires, GPT-Image-2 est le premier modèle qui change vraiment l'économie de la production créative. Pas parce que les images sont plus jolies (Midjourney garde l'avantage sur cet axe), mais parce qu'il génère enfin des assets marketing livrables : le texte est correct, les prix sont corrects, les libellés multilingues fonctionnent, et les ratios de sortie correspondent aux plateformes de diffusion réelles.

Cet article décortique GPT-Image-2 à travers sept scénarios marketing réels, couvre les retours communautaires des premiers utilisateurs, et donne les stratégies de prompt qui transforment la sortie d'« AI slop » à « prête pour la production ». Chiffres issus de tests réels, méthodologie complète.

En un coup d'œil : tableau de scoring GPT-Image-2

| Tâche marketing | Score GPT-Image-2 | Force principale | Limite principale |

|---|---|---|---|

| Images réseaux sociaux | 9/10 | Sortie multi-ratio en un clic | Débordement de texte |

| Variantes de créa publicitaires | 9/10 | Multilingue + A/B testing à grande échelle | Rendu de logo de marque peu fiable |

| Photographie produit | 8/10 | Étiquettes texte au pixel près | « Peau de silicone » sur les humains |

| Infographies | 9/10 | 99 % de précision texte, multilingue | Layouts complexes nécessitent des étapes |

| Bannières e-mail | 8/10 | Itération conversationnelle rapide | Match de couleur de marque imprécis |

| Menu / photographie culinaire | 9/10 | Texture nourriture + format de prix précis | Sensation « stock photo » trop léchée |

| Maquettes UI / landing | 9/10 | Rendu d'interface précis | Ne remplace pas Figma |

Méthodologie

Cet article agrège les retours de tests en production et les données publiques d'un large pool d'utilisateurs en accès anticipé depuis la sortie. Les axes d'évaluation incluent le pourcentage d'« utilisable sans post-traitement », le temps de workflow de bout en bout, et des comparaisons côte à côte avec le même prompt sur Midjourney V8 et Imagen 4.

Les sources incluent les discussions sur les communautés de développeurs, les vraies données de campagne partagées par les utilisateurs précoces sur des serveurs Discord orientés marketing, et les rapports de tests publics de tiers.

1. Contenu réseaux sociaux — la killer app

Pourquoi c'est différent

Tout marketeur connaît la douleur : la même créa doit sortir en 1:1 (feed Instagram), 9:16 (Stories), 16:9 (LinkedIn), et 3:4 (Pinterest). Jusqu'à présent, ça voulait dire quatre générations séparées (et quatre tours de retravail typographique). GPT-Image-2 supporte nativement les ratios de 3:1 à 1:3, dont 16:9 et 9:16. Un utilisateur précoce a décrit le workflow comme « ça fait l'effet de tricher » — vous calez le visuel une fois, puis vous gérez chaque variante de plateforme dans la même conversation.

Retours communauté

Les utilisateurs précoces rapportent qu'environ 75 % des images générées peuvent être utilisées telles quelles, sans Photoshop. Pour comparer, GPT-Image-1 plafonnait autour de 20 %. Un utilisateur a partagé l'expérience de produire un carrousel LinkedIn de six images pour le lancement d'une fonctionnalité SaaS — style de marque cohérent, noms de fonctionnalités précis, prix corrects — et chaque image est revenue avec un texte lisible et bien orthographié. Rien que ça est révolutionnaire face à DALL-E 3, qui n'arrivait pas à rendre une phrase de plus de trois mots.

La précision du rendu texte tourne autour de 99 % à la fois pour l'écriture latine et les caractères CJK (chinois / japonais / coréen) — de loin le plus gros déblocage pour les applications marketing. Une affiche japonaise avec un nom de produit anglais ? Un menu de restaurant arabe avec des étiquettes de prix au format occidental ? Il gère les écritures mixtes nativement.

Plus et moins

| Plus | Moins |

|---|---|

| Sortie multi-ratio native = gain de temps massif | Le modèle adore ajouter du texte — chaque prompt nécessite un garde-fou « no extra text » |

| Headline et CTA à 99 % de précision | Reproduction de logo peu fiable — toujours prévoir un compositing |

| Le Thinking Mode planifie la mise en page avant de dessiner | Les prompts complexes (500+ mots) sont partiellement ignorés |

| Un appel API rend 8 images de style cohérent | L'Instant Mode du tier gratuit a une qualité visiblement inférieure |

Pour qui c'est fait

Équipes marketing produisant 10+ images sociales par semaine avec des exigences fortes sur la précision texte, l'adaptation rapide multi-ratio, et le support multilingue.

2. Variantes de créa publicitaires — là où le ROI apparaît vraiment

Le problème d'échelle que GPT-Image-2 résout vraiment

Chaque agence pub fait face à la même pression : sortir cinq à dix variantes localisées de chaque créa core par semaine, sans budget pour une équipe de design supplémentaire. Le pourcentage d'images publicitaires « utilisables sans intervention de design graphique » est passé d'environ 20 % sur GPT-Image-1 à plus de 75 % sur Image-2. Ce n'est pas une amélioration marginale. Ça remplace un sprint de design à trois personnes par une seule personne qui écrit des prompts.

Retours communauté

Les utilisateurs précoces ont testé un scénario typique de pub Meta : une seule photo produit core devait sortir en anglais, japonais, espagnol et arabe, chacune avec des headlines et tarifs localisés. GPT-Image-2 a géré les quatre langues dans une seule conversation. La mise en page droite-à-gauche en arabe était correcte, les caractères japonais lisibles, les accents espagnols exacts.

Le déclic clé : le Thinking Mode du modèle planifie la composition avant de générer. Il fait des recherches web pour vérifier les conventions visuelles, compte les éléments, vérifie les contraintes de texte. Aucun autre modèle d'image n'a ça. Pour la créa publicitaire — où la précision bat l'artistique — c'est genuinement disruptif.

La réalité des prix

Les images standard coûtent environ 0,10 $ chacune (Instant Mode) ou 0,21 $ (Thinking Mode), donc produire 50 variantes pub revient à 5–10 $. Un freelance designer faisant le même travail coûte 500–2 000 $. Même en comptant le temps humain pour le compositing logo et la post-production, l'arithmétique est écrasante.

Cela dit, ChatGPT Plus (20 $/mois) est le plancher pour débloquer le Thinking Mode et un quota d'usage exploitable. Le tier gratuit plafonne à 2–3 images Instant Mode par jour — bien pour tester, pas pour la production.

Pour qui c'est fait

Équipes marketing performance qui font tourner de la créa multi-variantes et multilingue à grande échelle. Marques DTC qui rafraîchissent la créa chaque semaine. Agences qui jonglent avec 5+ comptes clients.

3. Photographie produit & e-commerce

À quoi « pixel-perfect » ressemble en pratique

Un blogueur tech a généré une variante mode sombre d'une page web à partir d'une seule capture d'écran et a qualifié la sortie GPT-Image-2 de « pixel-perfect » — texte et layout parfaits. En e-commerce, le modèle excelle sur : maquettes de packaging produit avec étiquettes lisibles, photographie culinaire avec étiquettes de prix précises, et scènes produit lifestyle.

Retours communauté

La photographie produit impliquant des humains a encore ce que la communauté appelle le problème de « peau silicone » — la texture de peau a l'air trop parfaite, les pores alignés comme un circuit imprimé. Mais pour les photos sans humain (packaging, électronique, alimentation), les résultats sont vraiment impressionnants. Les utilisateurs précoces rapportent un prompt de menu de ramen japonais où les kanji étaient corrects, le prix en yen correct, et la vapeur photoréaliste.

Pour qui c'est fait

Marques e-commerce avec un fort volume d'images, surtout alimentation, FMCG, et électronique — catégories où la précision des étiquettes compte le plus.

4. Infographies & dataviz

Pourquoi ça marche soudainement

C'est là que la précision texte multilingue à 99 % brille vraiment. Jusqu'ici, les infographies en IA voulaient dire générer un beau layout avec un texte foireux, puis passer 30 minutes dans Illustrator à corriger les étiquettes une par une. GPT-Image-2 rend les data labels, les annotations de graphiques, et les légendes multilingues assez clairement pour s'utiliser directement.

Les scénarios en langue mixte sont le gros déblocage : un graphique d'analytics produit pour le marché japonais avec un titre japonais, des data labels en anglais, et des annotations en chinois — un travail qui exigeait avant un designer à la main — s'achève maintenant en un seul prompt.

Retours communauté

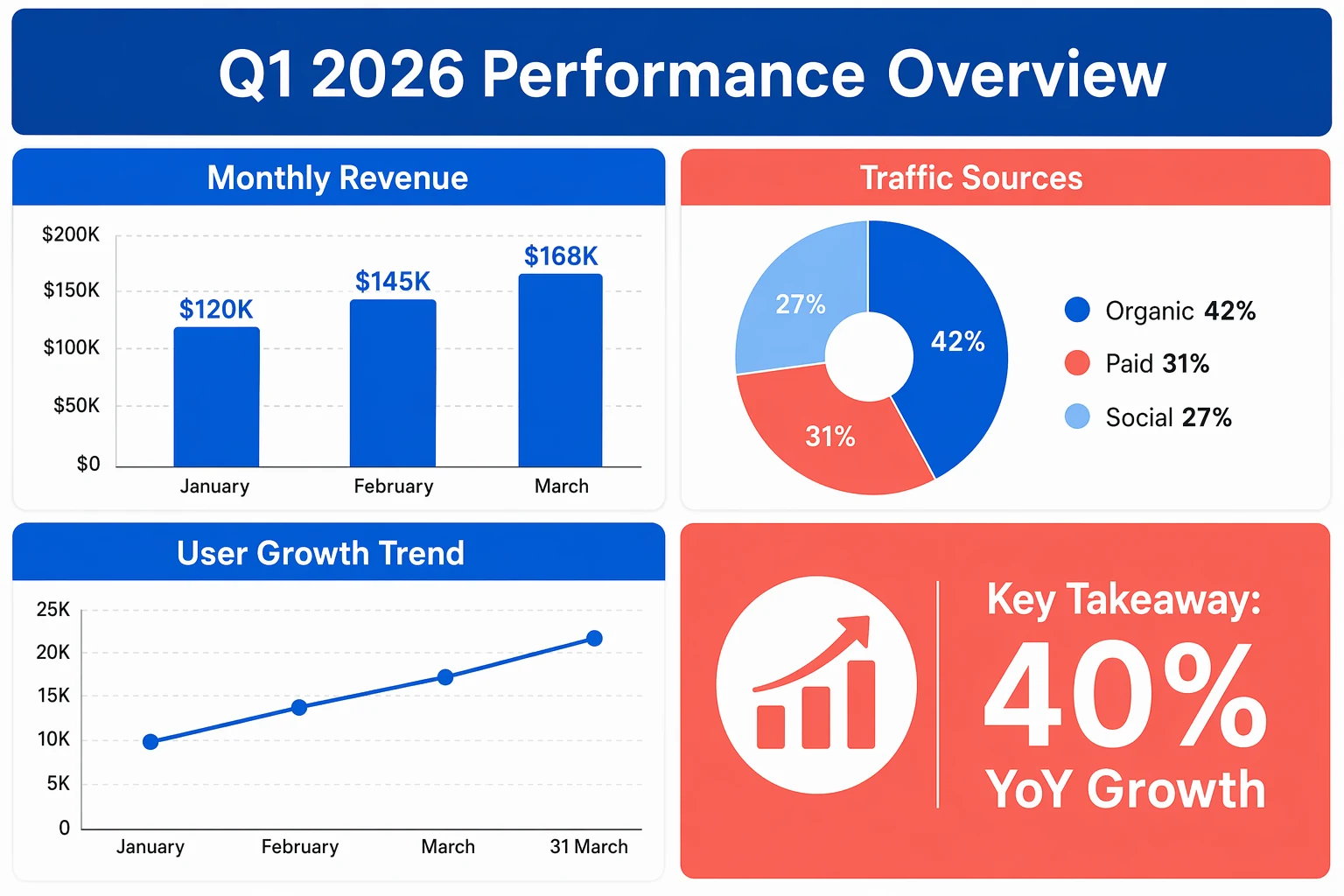

Les tests communautaires montrent que pour une infographie de dashboard marketing trimestriel (4 zones de graphique, 12 data labels, 2 paragraphes explicatifs, et 1 titre de marque), GPT-Image-2 en Thinking Mode a tout généré en une passe avec tout le texte lisible et tous les formats de données (pourcentages, symboles monétaires, dates) corrects. Le même prompt passé sur DALL-E 3 a produit 5 fautes d'orthographe sur 12 étiquettes.

A2E (une plateforme de benchmark dédiée à la génération d'image IA) rapporte que GPT-Image-2 économise environ 20–30 minutes de Photoshop par projet. À une cadence de 5 infographies par semaine, ça fait 2–3 heures gagnées chaque semaine.

Plus et moins

| Plus | Moins |

|---|---|

| Précision orthographique sur les data labels et annotations excellente | Layouts complexes multi-couches nécessitent encore une génération étape par étape |

| Langue mixte (CJK + latin) rend correctement en une passe | L'alignement précis (e.g., colonnes de tableau) dérive parfois |

| Le Thinking Mode planifie la hiérarchie d'info avant de dessiner | Le match exact de couleur de marque au hex est imprécis |

Pour qui c'est fait

Équipes content marketing qui livrent du contenu data-driven hebdomadairement, créateurs éducatifs, et équipes produisant des decks et des graphiques au niveau du slide.

Ce qui marche vraiment : une méthodologie de prompts marketing

S'appuyant sur les retours communautaires des premiers utilisateurs, voici les stratégies qui produisent systématiquement des assets marketing utilisables :

L'approche par couches. N'écrivez pas un prompt géant. Construisez par couches : commencez par la composition, puis le style, puis la typo, puis la couleur, puis les détails. La mémoire de conversation de GPT-Image-2 permet à chaque couche de s'appuyer sur la précédente.

Mettez votre copy entre guillemets. Tout texte qui doit apparaître dans l'image se met entre guillemets. "Spring Sale — 30% Off" rend bien plus précisément que de simplement décrire « une promo de printemps ».

Les prompts négatifs sont obligatoires. Le modèle adore ajouter du texte. Chaque prompt marketing a besoin de : "no extra text, no additional words, no random lettering, no watermarks."

Restez sous 500 mots. Le plafond 32K tokens est un plafond, pas une cible. Au-delà de quelques centaines de tokens, le modèle commence à ignorer les instructions précédentes. Des prompts courts et structurés battent les descriptions verbeuses.

Utilisez le Thinking Mode pour tout ce qui est texte-lourd. La qualité standard floute le petit texte. Tout ce où le copy porte le message doit tourner en haute qualité avec Thinking Mode activé.

Pour aller plus loin : Nous avons un guide complet de prompts pour GPT-Image-2 avec 15 techniques testées sur le terrain et la méthode par couches expliquée en détail.

Ce que GPT-Image-2 ne peut toujours pas faire pour les marketeurs

Vérité brute : ce modèle a des limites claires.

Les logos de marque sont peu fiables. Le placement final du logo nécessite encore Photoshop ou Figma. Ne luttez pas — intégrez l'étape de compositing dans votre workflow.

Les itérations multiples dégradent la qualité. Plusieurs utilisateurs communautaires rapportent qu'après trois révisions ou plus, l'image prend une « texture de bruit » visible et les ombres/lumières s'effondrent. Leçon contre-intuitive : les prompts courts battent les exigences créatives détaillées.

Le contrôle de style n'est pas aussi fin que Midjourney. Vous ne pouvez pas spécifier le type de pellicule, les paramètres d'objectif, ou la texture du grain comme Midjourney vous le permet. Si votre marque a une identité visuelle forte, la direction créative initiale peut encore avoir besoin de Midjourney V8. Comparaison détaillée dans notre revue cross-modèles.

Les filtres de sécurité peuvent être trop agressifs. Un utilisateur a rapporté qu'un prompt de scène cyberpunk avait été bloqué parce que les mots « une touche de danger » combinés à une ruelle pluvieuse ont déclenché le système. Les marques visant une esthétique osée peuvent buter contre des murs.

Le verdict pour les équipes marketing

GPT-Image-2 n'est pas le meilleur générateur d'images IA pour chaque tâche. Mais c'est sans ambiguïté le meilleur générateur d'images IA pour le travail de production marketing — le grind à haute fréquence, dense en texte, multi-format, multilingue qui dévore la bande passante de votre équipe design.

70 % des designers freelance dans une enquête récente ont dit qu'ils démarrent les projets créatifs sur Midjourney mais les terminent sur GPT-Image-2. Ce positionnement est exactement le bon. GPT-Image-2 est le modèle qui transforme un concept créatif en assets livrables à une fraction du coût et du temps précédents.

DALL-E 3 prend sa retraite le 12 mai 2026. L'API ouvre officiellement début mai. Si vous êtes encore sur DALL-E, la fenêtre de migration, c'est maintenant.

Le marketing ne s'arrête plus à l'image, il finit en vidéo. En 2026, le terrain principal de la pub à la performance, ce sont les courts formats vidéo. Une fois que vous sortez avec GPT-Image-2 des visuels marketing prêts à l'emploi, l'étape suivante naturelle est de les animer. Pixo, plateforme AI Video Agent, branche déjà GPT-Image-2 et Seedance 2 dans le même flux — le premier génère les storyboards avec un texte précis, le second les anime en vidéo, et l'aperçu en chronologie permet de visualiser l'enchaînement de plusieurs plans avant l'export. De l'affiche au spot vidéo, sur une seule plateforme — avec une bibliothèque multi-fournisseurs côté image (ByteDance, Google, OpenAI, xAI) et vidéo (Seedance 2, Kling, Hailuo). Inscrivez-vous sur Pixo pour des crédits gratuits, sans carte bancaire.

Sources :

- Introducing ChatGPT Images 2.0 — OpenAI Official Blog

- ChatGPT's new Images 2.0 model is surprisingly good at generating text — TechCrunch

- ChatGPT Images 2.0: Full Developer Breakdown — BuildFastWithAI

- GPT Image 2: 10 Practical Use Cases for Businesses — MindStudio

- Why GPT Image 2 Is Redefining Visual Creation for Creators — Programming Insider

- gpt-image-2 Review 2026: Real User Feedback & Limits — WeShop

- Ads and AI: Leveraging AI Creative in 2026 — Social Media Examiner